Средние модели, большие надежды: испытываем гибридные LLM

Привет, я Дмитрий, занимаюсь развитием LLMaaS. Перед нашей командой встала задача подбора «средней» языковой модели с примерно 9B параметров для обслуживания клиентских задач: оперативные чат-боты, саммаризация документов, генерация кода и аналитика на длинных контекстах. В таких сценариях критичны

Image: Habr

Привет, я Дмитрий, занимаюсь развитием LLMaaS. Перед нашей командой встала задача подбора «средней» языковой модели с примерно 9B параметров для обслуживания клиентских задач: оперативные чат-боты, саммаризация документов, генерация кода и аналитика на длинных контекстах. В таких сценариях критичны не только качество ответов, но и скорость, и стоимость инференса — ведь модель должна работать на одном GPU и при этом выдерживать заданный поток запросов.

Классические подходы — взять проверенную плотную модель вроде Llama 3.1 8B — дают неплохое качество, но упираются в память из-за тяжеловесного KV-кеша. Поэтому мы обратили внимание на гибридные архитектуры, где традиционное внимание чередуется с более экономичными механизмами: Mamba-2, Gated DeltaNet. Такие модели обещают радикально снизить расход памяти и увеличить пропускную способность без потери качества. Мы выделили три перспективные открытые модели этого класса: NVIDIA Nemotron-Nano 9B v2, Bamba-9B-v2 (IBM) и Qwen3.5 9B (Alibaba), и сравнили их с классической Llama 3.1 8B.

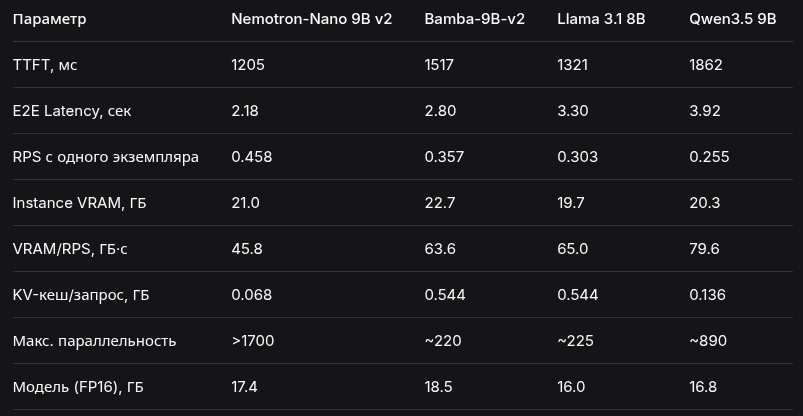

Моделирование проводилось для одного ускорителя NVIDIA H200 (141 ГБ) при типичной нагрузке: 4096 входных токенов, до 256 выходных. Рассчитывались метрики: Instance VRAM (память на один экземпляр с учётом весов, оверхеда и KV-кеша), E2E Latency, RPS с реплики, требуемый объём памяти на один RPS (VRAM/RPS), а также максимальная параллельность по памяти. Детальные расчёты и формулы мы ранее верифицировали с помощью собственного форка [InferSim](https://habr.com/ru/articles/1027358/) и публичных бенчмарков. Вот что получилось:

Читать далееОригинальная статья

Средние модели, большие надежды: испытываем гибридные LLM

Опубликовано Habr