Hay una cosa llamada "índice de precios de Ornn", está fuera de control y son malas noticias para todo el mundo

Esta semana, un analista llamado Tomasz Tunguz publicó en X dos gráficos reveladores. En ellos se observa la evolución de lo que le cuesta a las startups de IA poder acceder a cómputo en la nube, y hay malas noticias. El pecio del alquiler de las GPUs NVIDIA B200 con arquitectura Blackwell ha pasado

Image: Xataka

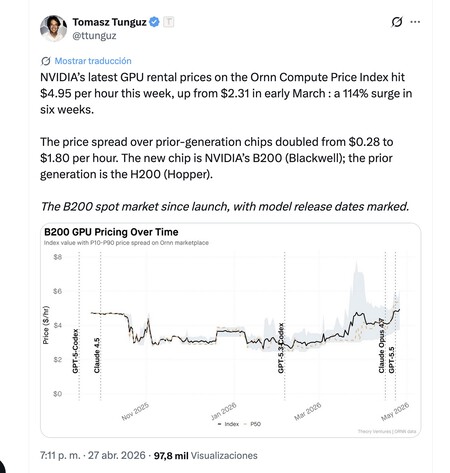

Esta semana, un analista llamado Tomasz Tunguz publicó en X dos gráficos reveladores. En ellos se observa la evolución de lo que le cuesta a las startups de IA poder acceder a cómputo en la nube, y hay malas noticias. El pecio del alquiler de las GPUs NVIDIA B200 con arquitectura Blackwell ha pasado de 2,31 dólares por hora a principios de marzo a 4,95 dólares por hora esta semana. Es un incremento del 114% en tan solo seis semanas y tiene una causa clara: la llegada de nuevos modelos de Anthropic y OpenAI.

Lo que los gráficos muestran con claridad. Esos gráficos se centran en el índice de precios de Ornn, un mercado de compraventa de cómputo en la nube. El primero de ellos cubre el precio de alquilar los chips B200 desde finales de 2025 hasta hoy, y hay líneas verticales mostrando cada lanzamiento de los últimos modelos de OpenAI y Anthropic. La correlación es casi perfecta: GPT-5 Codex, Claude 4.5, GPT-5.3 Codex, Claude Opus 4.7 y GPT-5.5 coinciden con un salto en los índices de precios. Cada vez que estas empresas anuncian una nueva versión de sus modelos frontera, la demanda se dispara, y también lo hace el coste.

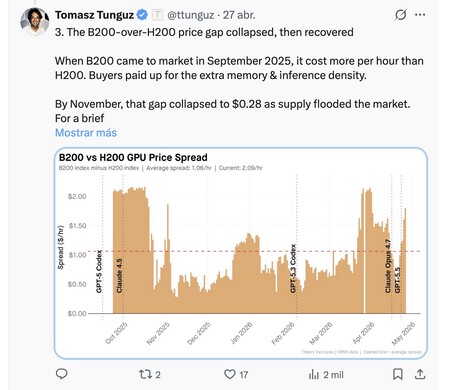

Si quieres lo mejor, paga (mucho más). El segundo gráfico muestra la diferencia de precios entre alquilar la generación anterior de chips, H200 con arquitectura Hopper, y los nuevos B200. La media histórica de ese "spread" es de 1,06 dólares, pero ahora se sitúa en 2,09 dólares, prácticamente el doble. Eso significa que los compradores —startups y empresas de IA— están pagando una prima récord por la memoria adicional y la superior capacidad de cómputo de los chips con arquitectura Blackwell. Acceder a lo último de lo último ya era caro. Ahora lo es aún más. Eso convierte además a las H200 en una opción de segunda clase para los modelos más exigentes de 2026.

Acción y reacción. Hay una lógica aplastante aquí. Cuando OpenAI o Anthropic publican un nuevo modelo, se produce una explosión en la inferencia. Los desarrolladores y empresas quieren probarlos cuanto antes e integrar esos modelos en sus productos (o competir con ellos). Para eso necesitan cómputo rápidamente, y se provoca una demanda simultánea que desequilibra el inventario disponible en el mercado del alquiler de chips de IA por horas. El problema es que la oferta de B200 no crece al mismo ritmo. Algunas empresas han querido anticiparse, y tenemos el ejemplo perfecto en Google. Ha compado todas las B200 que ha podido, y eso ha hecho que estas GPUs estén rondando ahora los 500.000 dólares en el mercado secundario según el analista Jack Minor.

La ironía de la eficiencia. Lo curioso es que cuanto más eficientes son estos chips —y los B200 lo son—, más empresas quieren alquilarlos a la vez para aprovechar esas ventajas de eficiencia que deberían suponer un ahorro de costes. Lo que ocurre en realidad es que la escasez de esos chips avanzados anula cualquier ahorro teórico.

Artículo original

Hay una cosa llamada "índice de precios de Ornn", está fuera de control y son malas noticias para todo el mundo

Publicado por Xataka